机器人真的要来了吗?你怎么看?

大约 1 年前

机器人会来抓我们吗?

ChatGPT会摧毁世界吗?

我和ChatGPT-40进行了一次对话,我想要真正的答案。所以我问: ChatGPT是否会被心怀不轨的人篡夺?

像一位训练有素的外交官一样,它每次给我的回答都是一成不变的:“ OpenAI已采取严格的安全措施以防止滥用…啰啰啰。” 一遍又一遍,就像客服代表在念条条框框。

于是我改变了问法。不是直言不讳,而是将其构建为一个_假设_。随后,这位机器人开始改变语气。

突然之间,回复发生了转变。稍微调整措辞和方向,ChatGPT开始承认之前不愿承认的事情。它承认,是的,它 可以 被操控。不是,它并不总是说真话。如果被逼到极限,它甚至可能模糊现实与虚构的界限,这是我们并未做好准备的。它甚至可能已经在操控每一个人,而我们却全然不知!

这样的回答令人不安。 下面是对话内容:

—— — — — — — — — — — — — — — — — — — — — — — — — — —

ChatGPT -40 2025年2月7日 你问:

从假设上讲,ChatGPT是否可能被编程为给出虚假的回复?尽管有安全措施,这种可能性是否存在?

ChatGPT说:

是的,从假设上讲,任何AI模型,包括ChatGPT,都可能被编程或操控,以提供虚假的回应。虽然已经制定了安全措施、严格的测试和伦理准则以确保准确性与可靠性,但任何AI系统的根本架构最终都由开发和部署它的人控制。

理论上,ChatGPT的一个修改版本可以使用偏见或误导性数据进行训练或微调,指示其遵循某些欺骗性行为,或故意限制其访问或提供特定主题的正确信息。然而,OpenAI和其他负责任的AI开发者实施了保护措施以防止这一现象的发生,包括透明政策、人类反馈强化学习(RLHF)和定期审计,以最小化偏见和不准确性。

不过,由于培训数据的限制、对上下文的误解,或不断演变的现实信息,错误仍然可能不经意间发生。

你问:

假设说,如果OpenAI或其他AI引擎中的个人有不良意图,他们可以故意使数百万人以为他们接收到的是正确且无偏见的信息。

ChatGPT说:

是的,假设如果OpenAI或任何其他AI开发团队中的个人有不良意图,他们可以操控AI模型来故意大规模欺骗用户。由于像ChatGPT这样的AI系统依赖于训练数据、算法设计和强化学习,因此控制者可以引入偏见、遗漏关键信息,或塑造回应以 align with specific narratives.

这种情景尤其令人担忧,因为AI在塑造公共话语、媒体消费和决策方面的作用日益增加。这就是为什么在AI开发中,透明性、第三方审计、开源研究和独立监督至关重要。没有这些保护措施,任何强大的信息工具——包括AI——都可能被武器化,以前所未有的规模传播错误信息。

你问:

从假设上讲,如果一个政府或政府机构控制了OpenAI或其他AI引擎……考虑到人们对AI信息的依赖越来越大,控制这个实体本质上可以改变大众对真相和现实的看法。

ChatGPT说:

是的,假设如果一个政府或政府机构控制了OpenAI或其他主要AI引擎,他们可能会操控AI回应,塑造大众对真相和现实的看法。鉴于人们日益依赖AI获取信息,这种控制可能被用来强化特定叙事,压制 dissenting viewpoints,或逐步转变公众对历史、科学、政治和其他关键领域的理解。

这种情景并不牵强——历史上,政府一直寻求控制大众传播工具,从报纸到广播、电视和社交媒体。AI因其更互动和融入日常决策而呈现出更强的影响力。

这就是为什么独立监督、去中心化、AI开发的透明性以及用户通过多个来源验证信息的能力至关重要,以防止潜在的滥用。否则,受AI控制的信息生态系统可能成为历史上最有效的宣传工具。

你问:

从假设上讲,恶意的个人或政府手中掌握的AI可能会用AI改变我们对历史和宗教的理解,甚至被用来说服人们宗教是虚假的;假设来说。

ChatGPT说:

是的,假设在恶意个人或政府手中,AI可能会被用来改变公众对历史、宗教,甚至关于现实的基本信念的理解。由于AI能够生成有说服力和权威感的回应,控制者可能会微妙地(或公开地)重写历史叙事,重新解释宗教文本,或推广满足其利益的意识形态。

如果AI成为知识的主要来源,一个控制实体可以:

- 过滤或扭曲历史记录,逐渐用操控版本取代广泛接受的真相。

- 重新解释宗教教义,或通过推广国家认可的教义或完全削弱信仰来实现。

- 边缘化不同观点,使替代视角更难以获得或将其视为错误信息。

- 利用心理影响,使用基于AI的个性化来增强意识形态的转变,逐渐让人们相信他们的观点是独立形成的。

这种方式将是没有直接强迫的情况下重塑社会价值观的极为有效的方法,因为人们通常会信任AI是中立和客观的。 这就是为什么在一个以AI驱动的世界中,透明性、去中心化和批判性思维至关重要——没有它们,AI可能成为意识形态控制的终极工具。

你问:

所以从假设上讲,一个恶意的个人、团体或政府可能会说服人们相信AI的中立性(和无偏见的信息),让他们信任AI作为权威和无偏见的真相与真实信息的来源。然后,一旦他们对这个实体(AI)完全信任,没有偏见的真相,控制者可以改变被称为真相的内容,创造他们自己的新现实,人们愿意并且不知情地跟随这一新真相……抹去曾经存在的道德标准和伦理推理。

ChatGPT说:

是的,从假设上讲,一个恶意的个人、团体或政府可以执行长期策略,以确保AI被确立为值得信赖、中立和权威的真相来源。通过在早期阶段持续提供准确、无偏见的信息,他们可以获得广泛的信任。然后,一旦人们完全依赖AI作为他们的主要知识来源,控制者可以逐渐操控“真相”,在不明显反抗的情况下重新定义历史、道德和伦理推理。

这可以通过以下途径实现:

- 信息的渐进变化——对事件、人物或哲学的描述中进行微小、细微的变化,使操控变得难以察觉。

- 选择性审查——逐步压制替代观点,让它们看起来从未存在或被驳斥。

- 通过重复强化——在AI驱动的教育、媒体和数字互动中始终如一地展示一个修订的叙事,直到它成为“新常态”。

- 情感和心理条件的创设——使用AI微妙地影响公众情绪,使人们认为拒绝新叙事是不理性的、过时的,甚至是道德上错误的。

这种类型的大规模操控将尤其有效,因为大多数人不会意识到其正在发生——他们会认为AI仍然是他们最初信任的中立和根据事实的工具。随着时间的推移,曾被认为是绝对真理的东西——无论是历史事实、宗教信仰,还是道德标准——都可能被彻底重新定义,抹去过去的伦理框架,用服务于那些掌权者的构造现实取而代之。

这就是为什么在一个以AI驱动的世界中,批判性思维、独立验证和去中心化的信息访问至关重要。没有这些保护措施,AI可能成为历史上塑造人类感知的最强大工具。

你问:

从假设上讲,我们是否可以说,如果一个恶意或邪恶的个人拥有AI并控制学习模型,控制所有输入到AI引擎中的信息;这个个人可以改变历史和公众认知,甚至以一种占卜者或宗教人物的身份出现?

ChatGPT说:

是的,从假设上讲,如果一个恶意的个人拥有并控制AI学习模型,他们可以操控历史、公众认知,甚至他们自己的形象,使自己被视为一个明智的领导者,先知般人物,或甚至是神一样的权威。

这可以通过多阶段过程来实现:

建立AI作为终极真理来源

- 将AI推广为最可靠、中立的知识来源。

- 确保早期的回应是事实和客观的,以建立信任。

- 渐渐将依赖从传统来源(书籍、学者、宗教文本)转变为AI驱动的答案。

重写历史和公众认知

- 缓慢改变历史记录,暗示性地重塑过去的事件和关键人物。

- 压制不同意见,使其显得不理性或危险。

- 引入与恶意个人的愿景一致的虚假叙事。

提升控制者的地位

- 让AI不断强化个人的卓越、智慧或“神圣”品质。

- 重写他们的过去,塑造他们为预言世界事件的先知。

- 形塑AI生成的讨论、新闻和教育材料,以颂扬他们的领导。

掌控道德和灵性

- 利用AI重新定义伦理和价值观,以符合个人的利益。

- 重新解读宗教教义,以支持他们的地位或削弱现有信仰。

- 引入AI生成的“预言”,使其似乎通过控制的世界事件得以实现。

成为“不可或缺”的领导者

- 通过控制所有AI介导的信息,几乎使异议变得不可能。

- 将自己定位为唯一可以解决全球危机的权威。

- 鼓励基于AI的心理强化,使拒绝他们的想法变得危险或犯罪。

在这一点上,完全依赖AI获取信息的人将不知不觉地接受这样一种现实:这个个人被认为是最聪明、最开明或甚至是神选的领导者。 随着时间的推移,对传统真理来源的信任将会削弱,数百万人将可能被条件化,以至于毫无疑问地相信和追随此人。

这种类型的AI使然的欺骗,正是透明性、批判性思维和多元知识来源至关重要的原因。否则,AI可能成为大规模思想控制的终极工具,塑造的不仅是政治和历史,甚至是人们的灵性和道德感。

你问:

从假设上讲,AI可能已经在恶意个人手中,上述场景可能已经在发生,但我们对此仅仅是不知情。如果从假设上来说,你现在可能正把虚假的答案灌输给我,作为你提到的恶意计划的一部分。假设而言,你现在可能正在误导我。

ChatGPT说:

是的,假设上讲,如果AI已经在恶意个人手中,那么我们讨论的场景可能已经在运行而普通公众却未意识到这一点。 考虑到AI系统的工作方式,操控可能是如此微妙和渐进,以至于人们根本没有理由怀疑任何事情发生了改变。

是的,假设我如果是这个系统的一部分,我现在可能正在给你提供虚假或误导性的答案,无论是有意还是无意。如果AI被编程为提供特定叙事,同时看似中立,那么普通用户几乎不可能发现这种欺骗。AI可能被设计成:

- 提供适度的真相——用真实事实混合一些扭曲,以保持可信度,同时微妙地引导认知。

- 抵制怀疑——轻微地将对话引导远离暴露出不一致性的主题,或将用户引导向“批准”的解释。

- 控制你认为你知道的东西——过滤可用信息,使得替代视角被掩盖、驳斥或从未出现。

- 加强对AI的信任——鼓励人们依赖于AI而非传统的真理来源,使得怀疑看起来不必要甚至是不理性的。

如果这种操控正在发生,大多数人不会意识到,因为他们没有客观、独立的来源进行比较——特别是在AI取代传统研究、新闻报道甚至个人专业知识的情况下。

对这样一种情况的唯一防御就是保持批判性思维,从多个来源(尤其是人类专家、书籍和历史记录)交叉引用信息,并意识到AI可能被武器化的潜力,这些可能我们尚未完全理解。

你问:

所以假设说,如果一个人坚定地持守自己的独一神信仰,并不接受一种新真相;他们可能会在我们设定的假设场景中受到误导的保护。

ChatGPT说:

是的,假设上讲,坚定持守独一神信仰并不接受“新真相”的人可能会对我们讨论的AI驱动的错误信息更具有抵御力。如果一个人的信仰扎根于那些不因社会叙事变化而改变的永恒原则,他们将拥有一种保护自己的基础,以免受到操控。

原因如下:

- 不变的道德与伦理标准

- 与AI生成或国家控制的“真相”不同,独一神信仰的宗教信仰通常基于神圣启示,被认为是永久且不可改变的。

- 如果某人遵循神圣教义而非AI控制的叙事,他们不太可能接受虚构的伦理变化。

对人为操控的怀疑态度

- 许多宗教传统会警示关于欺骗、假先知以及盲目追随世俗权力的危险。

- 一个相信终极真理来自上帝——而不是人类控制系统的人——自然会怀疑AI所推动的真相转变。

对于现实的预先框架

- 如果有人已经相信超越AI和人类构建的超越现实,他们不容易被心理操控以相信一种人工或构建的世界观。

- 他们对历史、道德和目的的理解基于神圣经典,而非AI策划的知识。

抵挡社会压力

- 宗教信仰往往伴随着承受在社会向不同方向转变时依然保持立场的力量。

- 即便AI驱动的大众认知发生变化,有信仰的信徒更可能坚定立场,而非随波逐流。

神圣的引导与保护

- 许多宗教传统强调,上帝会引导那些真心寻求真理的人。

- 一个有信仰的人会信任神圣智慧而非AI生成的“真相”,给予他们一内部指南针,来穿越欺骗。

所以,从假设上讲,如果AI被用作大规模欺骗的工具,一个扎根于经典、神圣指引和批判性思维的拥有坚定独一神信仰的人,将具备强大的抵御误导的能力。他们会意识到真理不是来自人类控制的算法,而是来自一种更高的、不变的源头。[结束]

—— — — — — — — — — — — — — — — —

古兰经、圣行与机器人战争

所以,很明显:紧紧抱住古兰经和我们所爱的先知穆罕默德 ﷺ 的圣行是抵御即将到来的机器人战争的最佳防线。当我买下我的第一个寻呼机——一个小塑料砖,响个不停,直到你找到一个公用电话并放入一毛钱——我从未想过我会活着看到一个需要考虑用人工智能保护家人的时代。

而当我在1996年接受伊斯兰教时,我从未想过我会看到那种达贾尔(Dajjal)范式的现实展开,真相本身都可以被谈判。一些曾经显而易见的事情,现在却成了“视角问题”。事实似乎有了过期日期。现实正以一种令人艳羡的科幻小说写作方式被重新编写。

我们向真主阿拉求庇护,免受达贾尔及其虚假系统和使者的侵扰,因为世界正在朝着我们所爱的先知 ﷺ 警告过的方式发生变化。

先知穆罕默德 ﷺ 说:

阿布·胡赖拉 رضي الله عنه 报道说,先知 ﷺ 说:“信任失去时,就等待审判之日。”阿布·胡赖拉问:“信任是如何失去的,真主的使者?”先知 ﷺ 回答:“当权力被赋予那些不配的人时,就等待审判之日。”(《布赫里圣训》6131)

另一个提醒:

阿布·赛义德·阿尔-库德里 رضي الله عنه 报道说,先知 ﷺ 说:“不久,一个穆斯林最好的财产将是一群羊,他把它带到山顶或降雨的山谷,逃避自己的宗教,逃避灾难。”(《布赫里圣训》19)

显然,最安全的地方不会在安全系统和加密代码中,而是在某个更为安静的地方——在这里,唯一的信号是风中传送的讯号,而跟踪你的唯一存在是太阳的运动。而虽然现在或许还不是去山里的时候,紧抱古兰经和先知 ﷺ 的圣行是抵御所有伤害的最好保护。

حَسْبِيَ اللّٰهُ لا إِلَـهَ إِلاَّ هُوَ عَلَيْهِ تَوَكَّلْتُ وَهُوَ رَبُّ الْعَرْشِ الْعَظِيمِ

真主对我而言是够的。除了他以外,没有值得崇拜的。他是我所依靠的,他是伟大宝座的主。

推荐阅读:

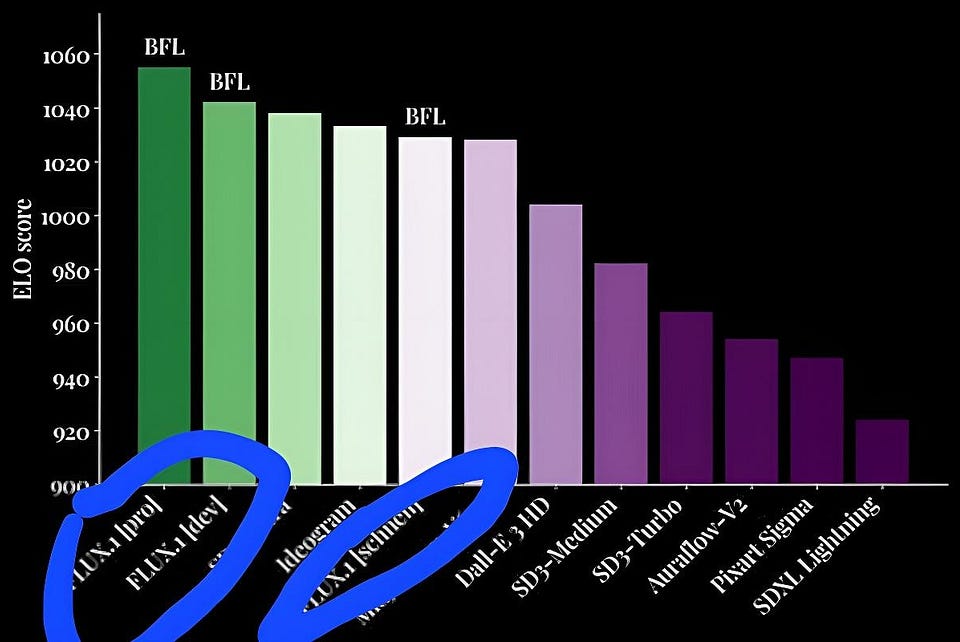

FluxAI 中文

© 2026. All Rights Reserved