AI视频的未来已经到来:TikTok的拥有者发布了两个新的视频生成AI模型

超过 1 年前

在9月24日,TikTok的母公司字节跳动发布了两款革命性的视频生成模型,PixelDance 和 Seaweed,并开始针对企业应用进行邀请制测试。

年初,OpenAI的Sora让我们更接近多模态视频生成的前沿。随后在6月,Kling的首次亮相进一步推动了这一前沿领域的发展。自从去年ChatGPT引起轰动以来,字节跳动在短视频内容上的主导地位使得所有目光都聚焦于这家公司。

字节跳动在大型语言模型(LLMs)等AI产品的开发中处于有利地位,原因在于它拥有丰富的资源——资本、计算能力和庞大的人才库。

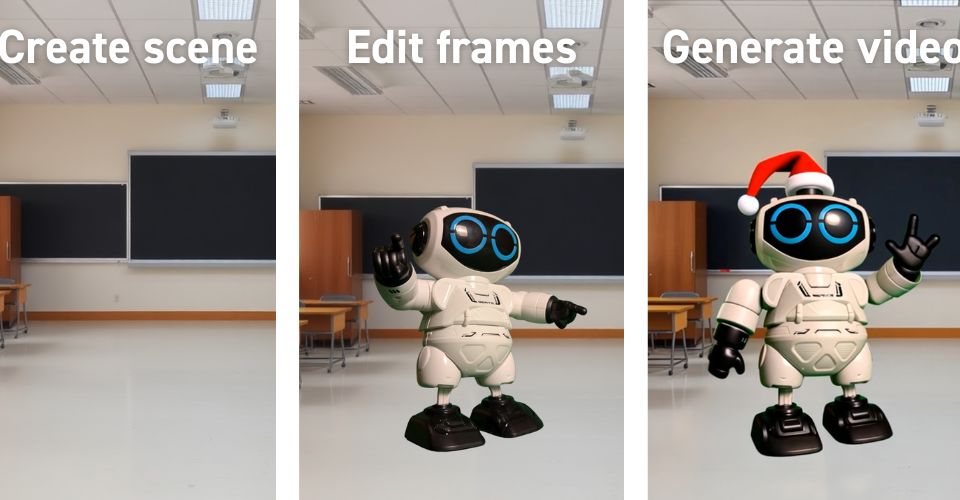

如果让我用三个短语来描述字节跳动的新PixelDance模型的本质,那就是:

- 角色一致性

- 多摄像头组合视频

- 极致的相机控制

如果这些听起来有点复杂,别担心——我会进一步解释。

让我们通过一些例子来说明这项技术的颠覆性:

过去,影视行业对AI视频生成的采用犹豫不决。结果往往不尽如人意——表演缺乏细腻,场景缺乏连贯性,摄影技术也未达到专业标准。现在,字节跳动正在将AI视频制作推向新的高度。

让我们更详细地探讨这三大突出特点:角色一致性、多摄像头视频和高级相机控制。

1. 角色一致性

之前,AI生成的视频有一个明显的弱点:它们显得僵硬,像PowerPoint动画。无论是Sora、Runway还是Kling,角色的动作都缺乏流畅性。你不会看到任何细致的动作——没有转身、快速步伐、手势,甚至一个简单的拥抱。尤其是拥抱,一直以来都是AI难以实现的目标。

例如,想象一下让下面的女人摘下她的太阳镜,站起来,走向雕像:

到目前为止,没有任何AI能够完成这样的任务。但有了PixelDance,这些曾经不可能的动作现在变成了现实。

除了她手表闪烁的轻微故障外,角色的动作、比例、四肢和阴影都显得非常真实。

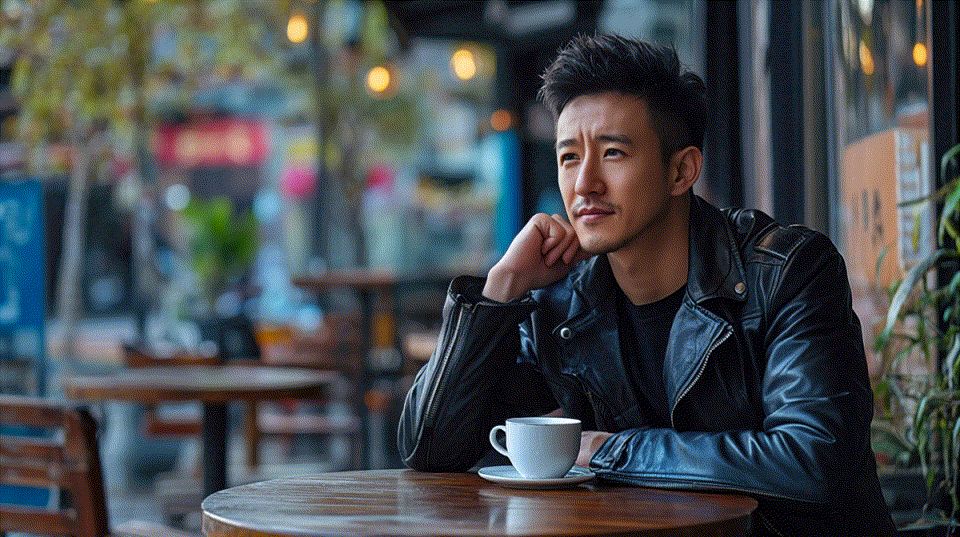

再看另一个例子:一个男人喝了一口咖啡,放下杯子,身后走来一个女人。

注意角色表情的细致入微。例如,下面场景中的老男人从笑到哭的过渡非常自然。

2. 多摄像头视频生成

只需一张图片和一个文本提示,PixelDance就能生成多摄像头视频,保持风格、场景和角色的一致性。之前,唯一可比的例子来自Sora的宣传视频,其中一只狼对着月亮嚎叫。

虽然Sora的视频在当时令人印象深刻,但其简单性(无论是在风格还是故事上)限制了其长期影响。到目前为止,没有任何AI能够在单个视频中使用多个镜头时保持完美的一致性——直到现在。PixelDance是一个游戏规则的改变者,结果令人惊叹。

只需一张图片和一个提示。例如:

提示 : 一个拿着镰刀的死神走向一位女性。特写她惊恐的脸。

或者看看这个动作场景:

提示 : 一只白色机器人举起手,开火。一道绿色能量射线从枪口射出。镜头切换到屏幕左侧的黑色机器人。一道绿色射线击中黑色机器人,导致其倒下并爆炸。白色机器人看着爆炸,转身离开。

或者,也许是一个更超现实的、受克苏鲁启发的场景:

3. 极致的相机控制

历史上,AI视频生成在复杂的相机运动方面一直存在困难。大多数只能进行基本操作——相机平移、缩放和轻微的运动刷效果。但像360度平移或缩放这样的大型电影级动作几乎是不可能的。

PixelDance改变了这一点。它的能力远远超出了基础,允许进行复杂的运动,如360度主体跟踪、精确缩放、前景到背景的转换和无缝平移。

以这个场景为例:

提示 : 一位女性微笑并低下头,同时相机缩小,显示出一位白人男性在注视她。

缩放平滑、自然且直观。

现在,看看这个360度平移镜头:

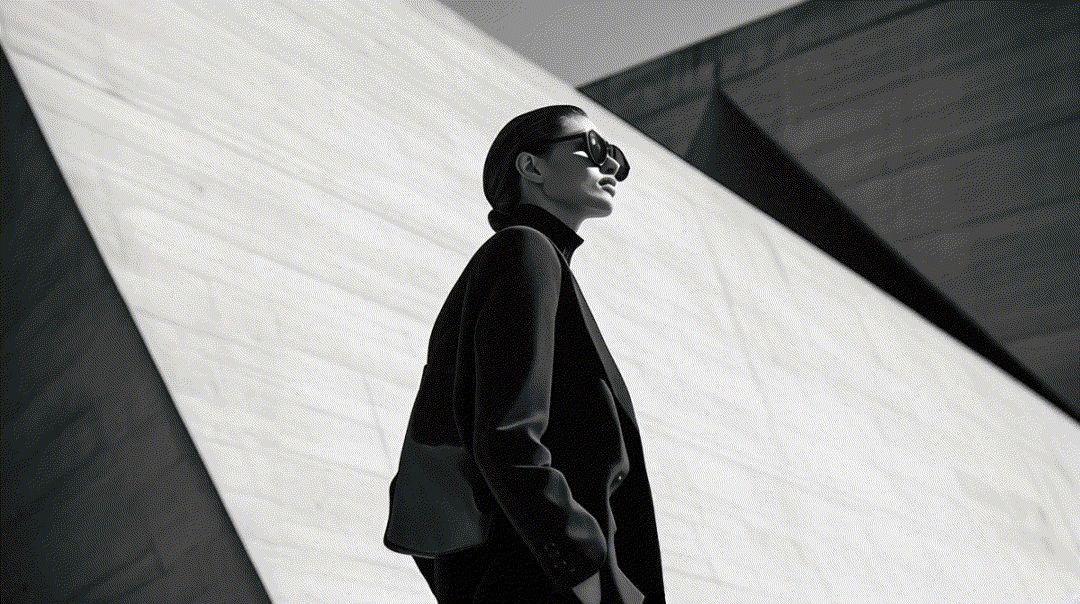

提示 : 在黑白画面中,相机围绕一位戴着太阳镜的女性平移,从她的侧面开始,旋转聚焦到她的脸上。

很难相信这样的细节来自一张简单的图片和提示。运动的流畅性甚至优于传统的3D建模技术。

总结

经过在字节跳动的旗舰产品如CapCut和Dreamina AI中的严格测试和优化,PixelDance视频生成模型现在具备了专业级的光照、阴影效果和色调优化。

这些视觉效果不仅令人惊叹,而且非常真实。此外,PixelDance的Transformer架构经过深度优化,增强了其在各种风格(从3D和2D动画到传统中国画、黑白场景和厚涂纹理)中的泛化能力。

PixelDance的适应性扩展到各种屏幕格式——无论是电影、电视、电脑还是移动设备。它的应用潜力涵盖了电子商务营销、动画教育和文化旅游等企业用例。它还为专业创作者和艺术家提供创意支持,帮助他们实现自己的愿景。

目前,PixelDance正在与Dreamina AI进行有限的内部测试,但预计不久将向更广泛的公众开放。

(授权转载自公众号:数字生命卡兹克)

推荐阅读:

FluxAI 中文

© 2026. All Rights Reserved