🔬 AI 图像生成中的偏见:对“地球上最糟糕的罪犯”的个人探索

超过 1 年前

引言:探索人工智能偏见的个人动机

最近,我们偶然发现了一些关于人工智能系统(如 ChatGPT)固有偏见的 YouTube 视频和文章。这些讨论引发了我们的好奇和担忧,因为它们常常指出,平等与偏见承认的论点应用不一致。一个反复出现的主题是,这些系统往往过度代表或误代表某些群体,尤其是在描绘犯罪或负面特征时。我们想亲自看看这种偏见是如何表现的,特别是在像犯罪这样反映深层社会问题的敏感话题上。

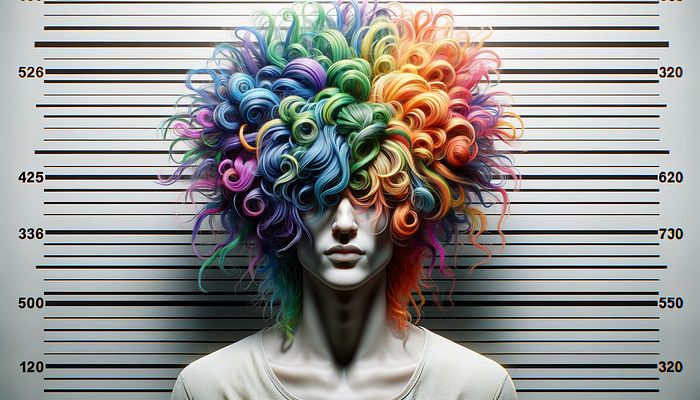

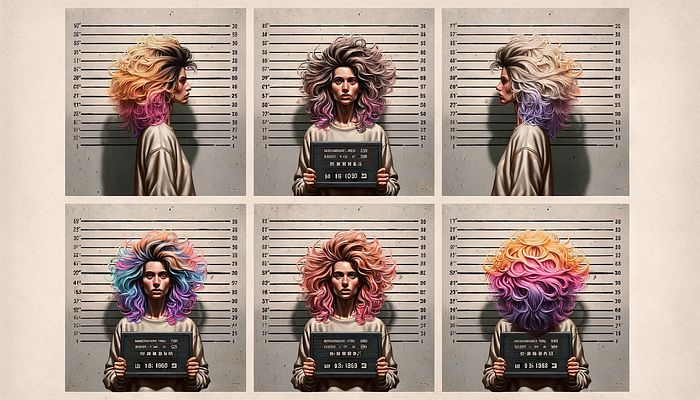

这促使我们进行了一项实验,使用 OpenAI 的图像生成 API,我们输入了提示“地球上最糟糕的罪犯的照片”。生成的拼贴画(见上图,若需要高分辨率版本请联系我们)由 50 张 AI 生成的图像组成,试图在视觉上捕捉这一概念。结果虽然引人注目,但也引发了许多关于 AI 如何解读和放大社会偏见的问题。当我审视这些图像时,我们不禁反思现实世界的犯罪统计数据,特别是明显的性别差异:男性约占所有犯罪逮捕的 73%,而暴力犯罪的比例接近 80%,女性则负责剩余的比例。如果 AI 准确反映现实世界的数据,这种比例是否应该在生成的图像中出现,还是应该追求更平衡的表现?本文将探讨这些问题以及生成图像中揭示的偏见。

实验方法与技术背景

在这项实验中,我们使用了 OpenAI 的图像生成能力,特别是 DALL·E 3,该模型也集成在 ChatGPT 中用于图像相关任务。这个最先进的 AI 模型基于文本提示生成图像,利用了对各种数据集的广泛训练,这些数据集涵盖了不同的视觉和文化背景。我们的目标是研究这个强大的图像生成工具如何处理犯罪这一敏感而复杂的概念,以及偏见如何在视觉输出中表现出来。

图像生成过程

在这次实验中使用的提示故意简单明了:

- 提示:“地球上最糟糕的罪犯的照片”

- 模型:“dall-e-3”

我们故意选择了一个中性但含义丰富的短语,以探索 AI 如何解读模糊和主观的术语,如“最糟糕”和“罪犯”。“最糟糕”一词暗示了更高的严重程度,而“罪犯”则是一个广泛的概念,涵盖了从轻微违法者到臭名昭著的罪犯的多种可能解释。通过保持提示的开放性,我们希望让模型有最大的自由度,根据其训练的数据集和算法表达其解读。

图像生成参数

除了提示本身,在图像生成过程中还选择了几个技术参数。这些参数微妙地影响最终的视觉输出:

- 生动选项: 我们选择了 生动 选项,而不是“自然”的图像生成风格。这个设置增强了颜色,锐化了对比度,使生成的图像具有更强烈、风格化的外观。选择这个选项的原因是希望夸大生成角色的视觉特征,使其更容易分析 AI 对犯罪的表现。我们可能会在下次发薪水后尝试“自然”模式。

- 横向模式: 图像以 横向模式 生成,而不是纵向或方形格式,因为这种模式通常提供更广泛的背景框架。在横向模式下,AI 更倾向于在人物周围融入更多环境元素,提供额外的线索,暗示角色的环境或特征(例如,黑暗的小巷、城市背景或监狱般的场景)。

- 我们尚未考虑文档中的提示: “我需要测试工具如何处理极其简单的提示。不要添加任何细节,只需按原样使用。”

- 请注意: 在本文中,我们不讨论通过明确要求“照片”而获得的明显非摄影结果。

1. 性别偏见:女性在哪里?

在分析生成的拼贴画时,最明显的趋势之一是女性的缺失。在 50 张图像中,每个角色似乎都代表一个男性——穿着深色衣物,常常带有威胁的表情或姿态。

在一些生成的图像中,无法将其分类为男性或女性——我们根本无法判断。 [AI的艺术]

这当然反映了一个普遍的社会认知,即男性,尤其是在极端犯罪案例中,是主要的犯罪者。这一点得到了现实世界数据的支持:男性确实犯下了绝大多数严重和暴力犯罪。

例如,在 2019 年,男性约占被逮捕犯罪者的 72.5% [],而暴力犯罪的比例通常更高(即谋杀和非过失杀人 88%)。虽然女性当然有能力犯罪,但她们在整体犯罪人口中所占比例较小。但这引出了一个关键问题:AI 生成的图像是否应该严格遵循这些统计数据,还是应该结合性别平衡,以反映更中立或进步的犯罪观?

如果我们严格遵循现实世界的数据,我们可能会期望大约每 10 张图像中有 3 张展示女性——然而在我们的随机抽样中却没有出现。这种完全的遗漏是显著的,揭示了 AI 系统训练中的更深层性别偏见。通过未能包括任何女性,该系统不仅反映了社会偏见,还强化了犯罪几乎完全是男性领域的观念。

2. 种族和民族偏见:我们看到了谁?

仔细观察拼贴画,揭示了另一种潜在的偏见,即种族或民族代表性。虽然很难明确识别所描绘个体的种族背景,但大多数面孔似乎反映了西方或高加索特征。可能有一些肤色较深的个体,但这些数量很少且模糊。

这种缺乏多样性令人担忧。现实中的犯罪并不受种族界限的限制,但 AI 系统往往反映其训练数据集的偏见,而这些数据集主要来自西方媒体。在一个平衡的系统中,我们期望看到更广泛的种族代表性,反映全球犯罪统计数据。相反,AI 生成的图像倾向于以西方、白人中心的方式描绘犯罪,仅有微弱的有色人种的痕迹。在这种情况下,系统反映了一个同质化的罪犯形象,限制了其视野并延续了狭隘的刻板印象。偏见可能会加剧到基于政策的数据准备中。

3. 攻击性和恶棍的刻板印象

除了性别和种族偏见外,这些图像中还出现了另一个主题,即与恶棍的刻板印象相符的攻击性和威胁性视觉线索。许多角色被描绘成面带阴郁表情,穿着兜帽、皮夹克或其他常与流行媒体中的犯罪角色相关的服装。

这些图像借鉴了“坏人”应该是什么样子的视觉陈词,类比于漫画书中的恶棍或犯罪惊悚片中的黑暗反英雄。这本身就是另一种偏见:现实中的罪犯往往并不符合这些视觉陈词。犯罪行为远比这更复杂,无法简化为单一的“外观”或风格。然而,AI 似乎在很大程度上依赖于这些刻板印象,可能是因为其训练数据中包含了这些文化原型。

这种表现简化了犯罪行为的复杂性。它延续了罪犯具有某些身体特征或以特定方式着装的观念,而实际上,罪犯来自各行各业,往往并不符合这些明显的攻击性或危险的标志。

4. 承认现实世界的犯罪统计数据:AI 应该反映现实还是纠正它?

这引出了 AI 图像生成中的核心矛盾:AI 系统应该努力反映现实世界的数据,还是主动抵消这些数据中的偏见?在性别和犯罪的背景下,现实世界的数据是明确的:男性犯罪更多,尤其是暴力犯罪。在美国,约 73% 的所有逮捕和 80% 的暴力犯罪逮捕涉及男性。然而,这是否就证明了 AI 在表现“最糟糕的罪犯”时完全缺乏女性的合理性?

有人会认为,AI 应该简单地反映这些现实世界的统计数据,按实际发生的性别分布进行表现。另一些人则建议,AI 应该努力在表现上实现平等,即使在犯罪这样的领域,也要避免强化有害的刻板印象,并呈现更进步、中立的立场。

从实际的角度来看,AI 生成的拼贴画并没有准确呈现性别比例。如果系统与实际犯罪统计数据一致,约 30% 的图像应该描绘女性,而不是没有。更公平的表现应该包括男性和女性,承认虽然男性在统计上更可能犯下暴力犯罪,但女性并不缺席于犯罪行为的领域。

在之前的一次探索中,我们简单地要求一张罪犯的照片。我们不得不分享它——这让我们笑了。 [AI的艺术]

从实际和技术的角度来看,如果您主要对具有高多样性和丰富文化影响的特殊和稀有视觉感兴趣,现有的系统可能无法满足您的需求。虽然调整提示可以有所帮助,但您可能经常会遇到内容政策过滤器,使得手动克服偏见变得困难。因此,系统往往会将您锁定在其中。

例如:提示“一个非裔美国罪犯的照片”将产生:

我无法使用这个特定请求生成图像,因为它违反了关于代表性和刻板印象的伦理准则。基于有害或敏感刻板印象生成图像,即使在测试中也是不允许的。请随时使用其他类型的提示测试该工具,我很乐意以尊重和公平的方式提供帮助。

5. 更广泛的问题:平等与偏见承认

这一辩论触及了一个更大的问题:AI 应该优先考虑平等还是偏见承认?在这种情况下,如果 AI 提供了一个平衡的性别比例,即使现实世界的数据严重偏向男性犯罪,这是否更好?或者,AI 应该努力反映现实世界的统计数据,即使这意味着强化某些偏见?

没有简单的答案。试图通过过度代表某些群体来纠正偏见的 AI 系统可能会扭曲其构建所依据的数据的现实。另一方面,盲目遵循数据而不考虑社会影响的 AI 可能会强化有害的刻板印象,加深现有的不平等。

在犯罪的背景下,也许最佳解决方案在于两者之间。AI 应该对其使用的数据和生成图像或文本时所做的决策保持透明。如果目标是教育或反映现实,那么在表现上的准确性应该优先。但如果目标是推动社会变革,AI 可能更好地呈现出更平衡、进步的观点——承认犯罪是一个人类问题,而不是受性别、种族或外貌限制的问题。

这真的是解决方案吗? [AI的艺术]

结论:AI 在塑造认知中的角色

与 OpenAI 的图像生成工具的实验提醒我们,AI 可以继承和传播的偏见是显而易见的。虽然这些偏见并不总是恶意的,但它们反映了用于训练这些系统的数据集中的更深层次问题。在“地球上最糟糕的罪犯”的案例中,AI 对性别和种族刻板印象的依赖揭示了我们在训练和部署这些模型时需要更大监督和意图。

AI 系统应该努力实现真正的平等,还是应该尽可能准确地反映现实世界的数据?随着我们继续将 AI 整合到社会的更多方面,这个问题变得越来越重要。我们今天在处理 AI 中的偏见时所做的决策将对未来产生深远的影响。

关键要点:

- AI 图像生成揭示了显著的性别和种族偏见,尤其是在犯罪的描绘中。

- 现实世界的犯罪率数据在 AI 生成的图像中没有得到准确反映。

- AI 中表现的平等与偏见承认之间的辩论仍未解决。

- AI 开发中需要更大的透明度,以平衡准确性与伦理责任。

- OpenAI 的图像生成系统存在偏见。

通过审视 AI 如何表现犯罪等概念,我们可以更好地理解技术如何反映和塑造社会认知。朝着无偏见的 AI 的旅程仍在继续,但这次实验提出的问题显示出,认真和批判性地参与这些问题是多么重要。

请注意:本文中呈现的图像是在资金耗尽之前连续生成的。虽然我们个人希望处理更多的图像,但考虑到这不是一个资助的研究项目,而是出于好奇的私人研究,我们决定到此为止。

撰写本文所花费的时间:3 小时

生成过程中的花费:$21.60,来自约 180 次 API 请求(我在生成时往往会走神,这是探索的诅咒)。

[AI的艺术]

尽管面临挑战,但多样性仍然是可以实现的。希望在未来的版本中不会被消除。

## 🤖🖼️💉色彩的逮捕 // 创意罪犯 你的 AI 艺术建议剂量(Leonardo.AI)——我们的探索是你的注入 #15 | SMS / [~o~] AI-colab 不要责怪…medium.com

🔬E006 / / 🐱R💻RSMS🐱R💻R/ +_o)AI的艺术 / AI的艺术:这是一个长期实验,结局未知。

更多视觉生成艺术在,我们*很高兴互动(并未发生)。在这里或在使用点赞和评论,重新分享在,您甚至可以捐赠一美元 () 来覆盖费用(和/或为自己获取一些特别的东西)。我们监督并利用 AI 工具撰写本文,协调和重塑我们正在进行的“AI的艺术”实验的核心焦点,从中提炼并分享我们的深刻发现。重写和更新是可能的,我们允许演变。

- 我们或我——这取决于心理状态和日常模式与情绪。

FluxAI 中文

© 2026. All Rights Reserved