"AI训练秘籍:模型、配置全公开,一键获取训练数据集!"

超过 1 年前

模型训练实验与完整指南教程:微调与LoRA对比

你可以在这里下载模型:https://civitai.com/models/911087

本仓库包含了对微调/DreamBooth与LoRA训练方法进行比较的实验结果。

我在这里分享了我是如何训练这个模型的,包括所有细节和数据集:请仔细阅读整篇文章。

这个模型纯粹是为了教育和研究目的而训练的,适用于SFW(安全内容)和伦理图像生成。

本教程中的工作流程和配置可以用于训练服装、物品、动物、宠物、物体、风格等任何内容。

上传的图像带有SwarmUI元数据,可以完全重新生成。生成时使用了FP16模型,但FP8应该能产生几乎相同质量的结果。别忘了在提示中使用YOLO面部遮罩模型。

如何使用

将模型下载到SwarmUI的diffusion_models中。然后你需要使用Clip-L和T5-XXL模型。我推荐使用T5-XXL FP16或Scaled FP8版本。

最新的完整公开教程在这里:https://youtu.be/-zOKhoO9a5s

额外资源

- 安装程序和配置文件:https://www.patreon.com/posts/112099700

- FLUX微调/DreamBooth从零到英雄教程:https://youtu.be/FvpWy1x5etM

- FLUX LoRA训练从零到英雄教程:https://youtu.be/nySGu12Y05k

- 完整数据集、训练配置Json文件和测试提示:https://www.patreon.com/posts/114972274

- 点击下方链接免费下载所有训练好的LoRA和微调/DreamBooth检查点

- https://huggingface.co/MonsterMMORPG/Model_Training_Experiments_As_A_Baseline/tree/main

环境设置

- Kohya GUI版本:

021c6f5ae3055320a56967284e759620c349aa56 - Torch: 2.5.1

- xFormers: 0.0.28.post3

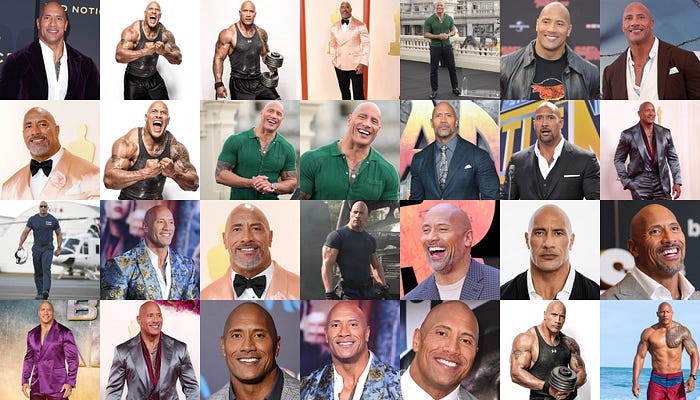

数据集信息

- 分辨率:1024x1024

- 数据集大小:28张图片

- 标注:"ohwx man"(无其他内容)

- 激活令牌/触发词:"ohwx man"

微调/DreamBooth实验

配置

- 配置文件:

48GB_GPU_28200MB_6.4_second_it_Tier_1.json - 训练:最多200个epoch,使用一致的配置

- 最佳结果:第170个epoch(主观评估)

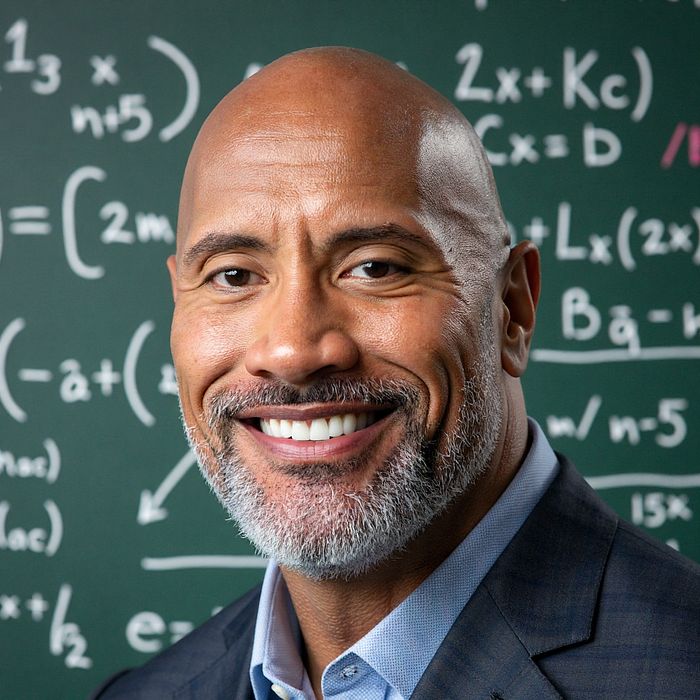

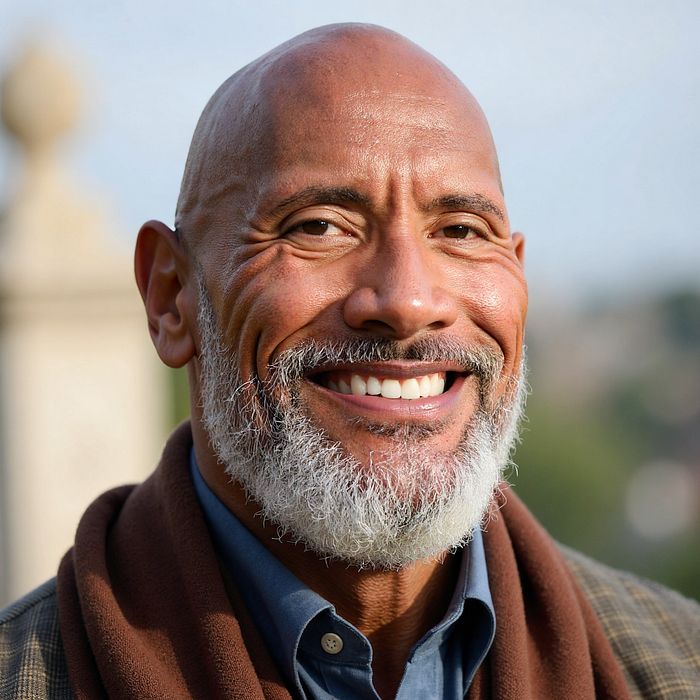

结果

LoRA实验

配置

- 配置文件:

Rank_1_29500MB_8_85_Second_IT.json - 训练:最多200个epoch

- 最佳结果:第160个epoch(主观评估)

结果

对比结果

关键观察

- LoRA在生成真实图像时表现出色,但在生成风格化图像时显示出更明显的过拟合。

- 微调/DreamBooth的表现优于LoRA,符合预期。

模型命名规范

微调模型

Dwayne_Johnson_FLUX_Fine_Tuning-000010.safetensors- 10个epoch

- 280步(28张图片 × 10个epoch)

- 批量大小:1

- 分辨率:1024x1024

Dwayne_Johnson_FLUX_Fine_Tuning-000020.safetensors- 20个epoch

- 560步(28张图片 × 20个epoch)

- 批量大小:1

- 分辨率:1024x1024

LoRA模型

Dwayne_Johnson_FLUX_LoRA-000010.safetensors- 10个epoch

- 280步(28张图片 × 10个epoch)

- 批量大小:1

- 分辨率:1024x1024

Dwayne_Johnson_FLUX_LoRA-000020.safetensors- 20个epoch

- 560步(28张图片 × 20个epoch)

- 批量大小:1

- 分辨率:1024x1024

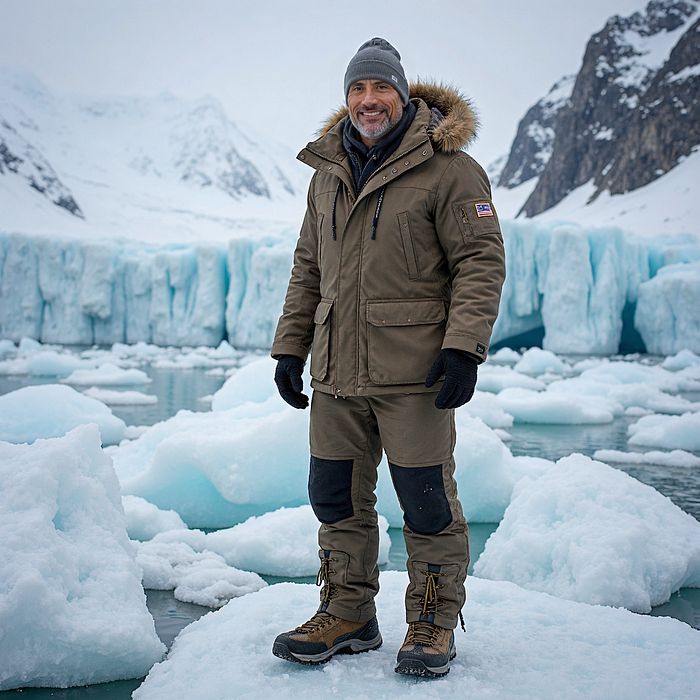

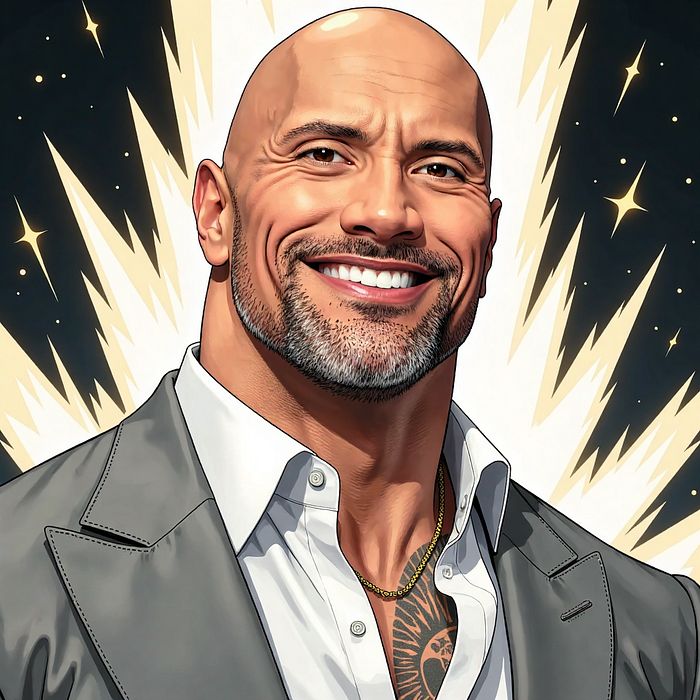

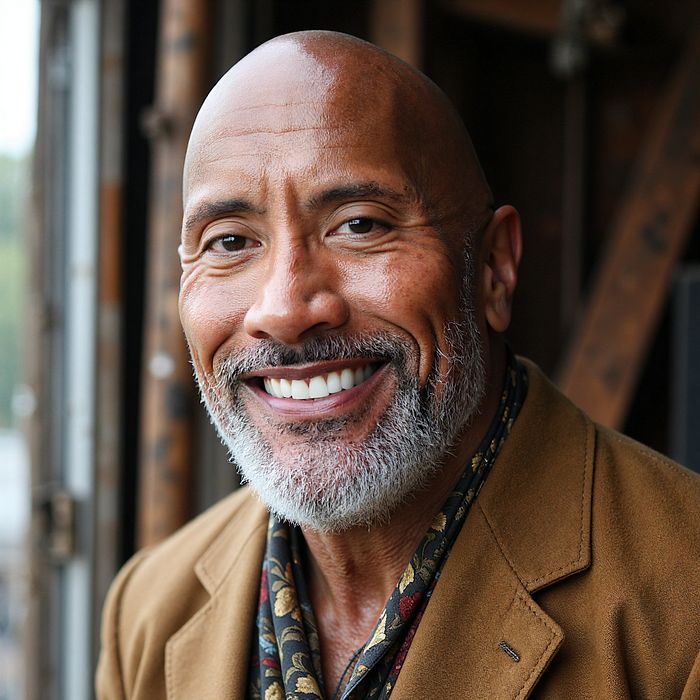

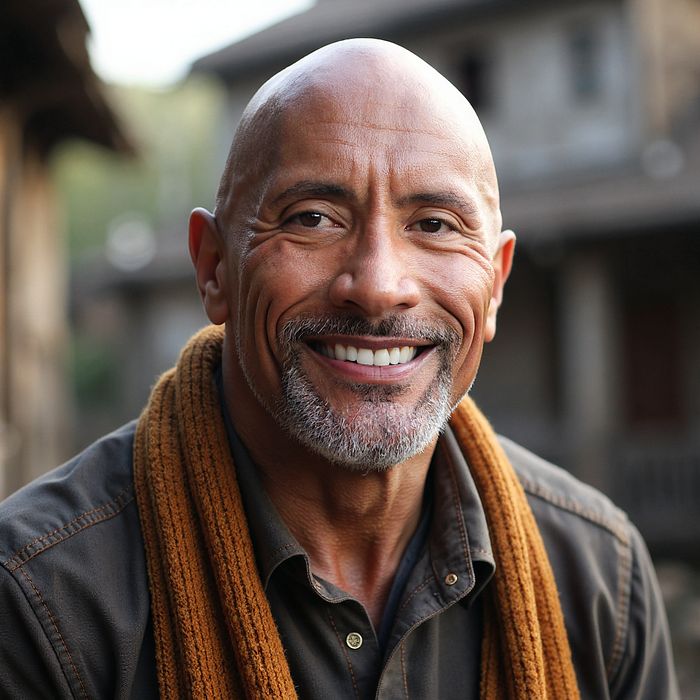

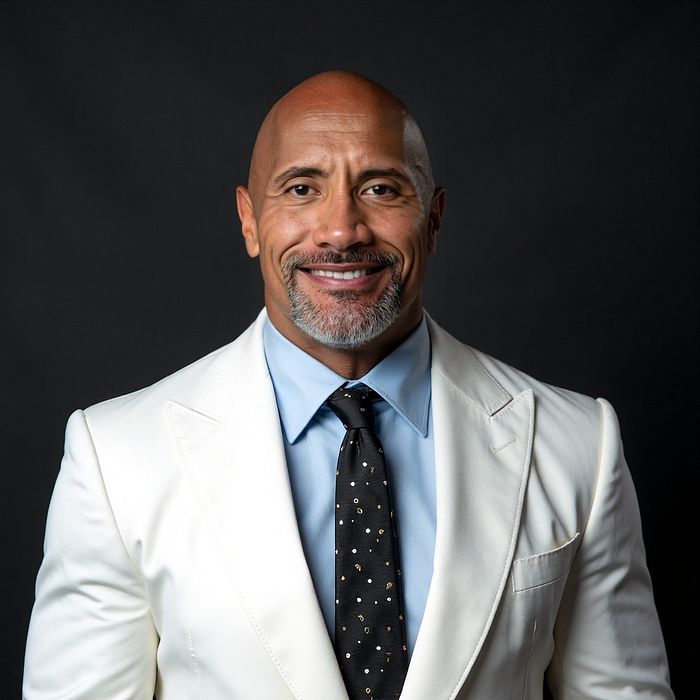

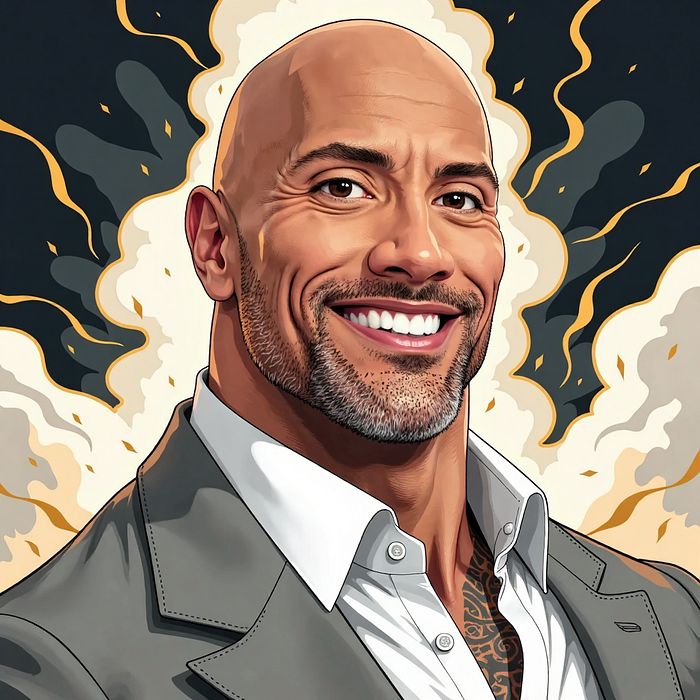

训练图像数据集和示例生成图像

你可以在以下链接找到完整分辨率的训练数据集和更多内容:https://www.patreon.com/posts/perfect-quality-114972274

推荐阅读:

【AI绘画新突破】Stable Diffusion 3.5大揭秘!最佳配置教程+与FLUX DEV大比拼,你更看好谁?

本教程详细介绍了如何使用Stable Diffusion 3.5 Large模型,并与其竞争对手FLUX DEV进行全面比较。教程涵盖了最佳配置、采样器和调度器的测试结果,以及如何在Windows上安装和使用SwarmUI。此外,还讨论了SD 3.5 Large与FLUX DEV的性能对比,包括FP16与Scaled FP8的比较。教程还包括如何使用SwarmUI进行大规模计算和RunPod的使用。最后,提供了关于如何使用Stable Diffusion 3.5 Large和FLUX DEV的详细指南,以及社区Fine-Tuning模型的潜力。

FluxAI 中文

© 2026. All Rights Reserved